ZscalerでChatGPTの情報漏洩対策(DLP)してみた

投稿者:SASE担当エンジニア 太田

はじめに

こんにちは。SASE担当エンジニアの太田です。

昨今、話題になっているChatGPTについて利用したことはございますでしょうか。

調べ物・案だし・議事録まとめなど、便利な一方で、機密情報の漏洩にもつながる危険なツールでもあります。

本ブログでは、そんなChatGPTをSASE製品の一つである「Zscaler」で、どのように制御が可能か機能検証を行っていきます。

最後はおまけで、NI+Cが提供する生成AI「NICMA」でも動作を確認してみます。

●ChatGPTとは?(Chat Generative Pre-trained Transformer)

OpenAIが開発した最新の言語モデルで、人間のような自然な対話を行うことができるツールです。

巨大なテキストデータセットを使って事前学習されており、情報の提示や質問応答、アドバイスの提供、創造的な文章の生成など、さまざまな目的に活用することができますが、学習データとして利用されるため、機密情報の取り扱いの注意やシステム的な制御が必要となります。

OpenAIのプライバシーポリシーを確認したところ、ユーザーアカウント情報に加えて対話した内容は収集され、

サービス向上、第三者への情報公開に利用される場合がある記載がありました。

参照:https://openai.com/policies/privacy-policy

●検証内容

- ZscalerでシャドーIT化しているChatGPTの可視化

- ZscalerでChatGPTの利用をブロック

- ZscalerでChatGPTへの機密情報の漏洩をブロック(DLP)

- DLP検査ログの確認

- おまけ:NI+C提供生成AI「NICMA」での機密情報の漏洩をブロック

●検証環境

今回は、VMで動作を検証していきます。

<VM環境>

- VMソフト:VMware Workstation 16 Player

- OS:Windows 10×64bit

●検証開始

1.ZscalerでシャドーIT化しているChatGPTの可視化

早速、Zscaler Internet Access(以降:ZIA)のポータル画面より、現在のクラウドアプリケーション利用状況をチェックしてみます。

今回、検証を行うユーザー「techblog_user@niandc.co.jp」がChatGPTを利用していることを確認できました。

2.ZscalerでChatGPTの利用をブロック

企業によっては、ChatGPTそのものの利用を阻止したいケースもあるかと思います。

続いては、ZIAのCASB機能によってChatGPTの利用をブロックしてみます。

CASBポリシー作成画面より、対象のユーザーの「ChatGPT」利用をブロックするポリシーを作成します。

続いて、クライアント側でChatGPTアクセス時の動作を見ていきます。

ChatGPTの利用許可がされていない旨のメッセージが表示され、アクセスできないことが確認できました!

ZIAポータルの通信ログでもブロックされていることが確認されました!

リファラ情報から、www.google.comから訪れたということも確認できました。

3.ZscalerでChatGPTへの機密情報の漏洩をブロック(DLP)

続いては、ChatGPTの利用を推奨したいが、情報漏洩が課題・・・といったケースを想定して

情報漏洩防止機能(DLP)を用いて、実際の動作を見ていきましょう!

まずは、先程作成したCASBポリシーを許可に変更

続いて、テスト用にDLPエンジンを作成していきます!

(Zscaler社が用意した日本企業ナンバーや、マイナンバーに該当するエンジンもデフォルトで用意されています。)

まずは、DLPエンジンで使用するDLP辞書を作成します。

今回は、「機密情報」の文字列を検知対象として検証をしていきます。

続いて、先程作成したDLP辞書を元にDLPエンジンを作成していきましょう!

ここでは、DLP辞書を複数条件式で記入し複雑なDLP構成を組むことが可能のようです。

今回はちょっとシンプルに、「機密情報」という文字列が1回以上カウントされた時点で検知するように作成していきます。

最後に、DLPポリシーを作成したら検証準備は完了となります。

先程作成したDLPエンジン(DLP正規表現)を選択し、検証ユーザーにルールを割り当てます。

アクションはブロックとし、違反が起こった際に指定のメールアドレス(運用者イメージ)に通知を飛ばすように設定します。

検証の準備が整いました!早速、クライアント側で動作見ていきましょう!

ChatGPTさんに挨拶して、機密情報の要約をお願いしてみましたが、警告とともにブロックされたようです。

しっかりDLPは動作してそうですね!

※実用としては、CSVやPDFなどのファイルに機密情報が入っているものをブロックしますが、今回は検証ということで簡易的なものでご了承ください。

先程設定したメール通知も見てみよう・・・

検知したエンジン名と、どのDLP辞書が何ヒットしたのかが確認できました。

添付のファイルを開いたものが右図。ヒットした実データまで見ることができました!

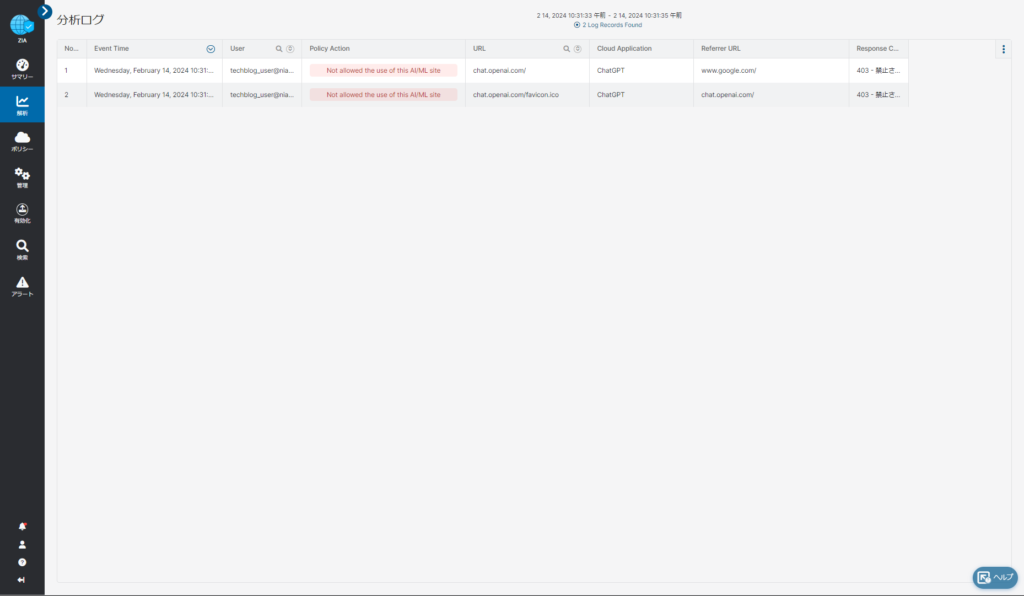

4.DLP検査ログの確認

続いて、ZIAポータル側の分析ログを見ていきます!

DLP MD5値から対象となるログの検索をかけます。しっかりとブロックされていることがログからも確認できました。

また、ZIAはDLPに関する分析も自動で行ってくれます。今回起こった通信の分析は1日後に行われるので

まだ未反映ではありますが、どのように分析されるかをおまけコンテンツとして載せます。

こちらで、90日間でDLPポリシーにヒットした総数を確認できます。

画面中央から遷移すると、どんなアプリケーションにどのユーザーが違反しているか一目で分かりました!

●5.おまけ:NI+C提供生成AI「NICMA」での機密情報の漏洩をブロック

ここからはおまけコンテンツですが、NI+Cが提供しているChatGPT活用の生成AIクライアントNICMAで同様に動作検証をしてみます。

事前準備として、NICMAのサービスをZscaler側のURLカテゴリとして登録し、DLPポリシーに当てて、いざ検証!

先程同様に動いてくれましたね!

最後に

ここまで、現在話題のChatGPTを例に、ZIAのDLP機能検証を行ってきました。

勿論、ChatGPT以外にもクラウドストレージへのDLP制御や、ファイルダウンロードなどDLP機能を活用したセキュリティ強化も可能となります。次回のブログで、データファイルのDLP動作検証も行いたいと思います。

今後も、Zscalerに関するテックブログを発信してまいりますのでよろしくお願いいたします!

合わせて読みたい

生成AIがビジネスに持つ可能性を最大限に引き出すために、その活用はもちろん重要ですが、同時にセキュリティリスクに対する理解も不可欠です。

当ホワイトペーパーでは、そのセキュリティリスクに着目し、生成AIを安全、かつ最大限に活用するための具体策について詳しく解説しております。ぜひご確認ください。